A l’avenir, Siri pourra reconnaitre nos émotions (brevet)

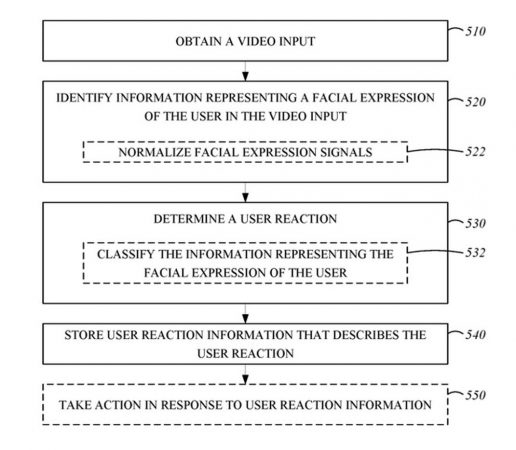

Apple réfléchit déjà à des versions très avancées de son assistant vocal. Siri 3.0 pourra non seulement traduire en temps réel dans plusieurs langues ou reconnaitre parfaitement les expressions les plus familières, mais sera aussi capable de reconnaitre nos émotions… en analysant notre visage. Le brevet numéro 20190348037 décrit un système d’analyse et de reconnaissance faciale s’appuyant sur la technologie FaceID. Le logiciel serait ainsi à même de reconnaitre certains patterns ou mouvements des muscles faciaux afin de déterminer de façon globale l’état émotionnel de l’utilisateur.

Cette reconnaissance d' »émotions » permettrait notamment de rectifier certaines erreurs de Siri, qui « verrait » ainsi directement sur le visage de l’utilisateur si la réponse apportée correspond bien à ce qui était demandé. Siri pourrait aussi rectifier ses « conseils » ou propositions contextualisées en fonction des émotions faciales détectées. On notera enfin que les expressions faciales analysées par le système devront correspondre au catalogue standard du Facial Action Coding System (FACS), qui recense toutes les expressions faciales possibles.

Dans la majorité des moments où on utilise Siri, on n’a pas le visage en face de l’iPhone je trouve.. j’aurai préféré la reconnaissance d’émotion par la voix (le ton), ça serait plus logique

+1

Et pour le HomePod?

J’aimerais déjà qu’il comprennent que je veux « allumer les lumières de la chambre »….

Tu m’as tué

Oui… déjà que Siri ne comprend rien à mes requêtes…

🤔

XD comment il sera désactivé direct pour ma part…

Tout ce qui est reconnaissance faciale poussé à ce point ça fait peeuuurrrrr 😱 : voir ce que font déjà les Chinois dans leurs rues, et ça va s’aggraver très vite, avec en plus les émotions… ce qu’on a vu dans les pires scénarios de SF va se réaliser.