iOS 26 : les API de transcription vocale font des merveilles… et enfoncent la concurrence

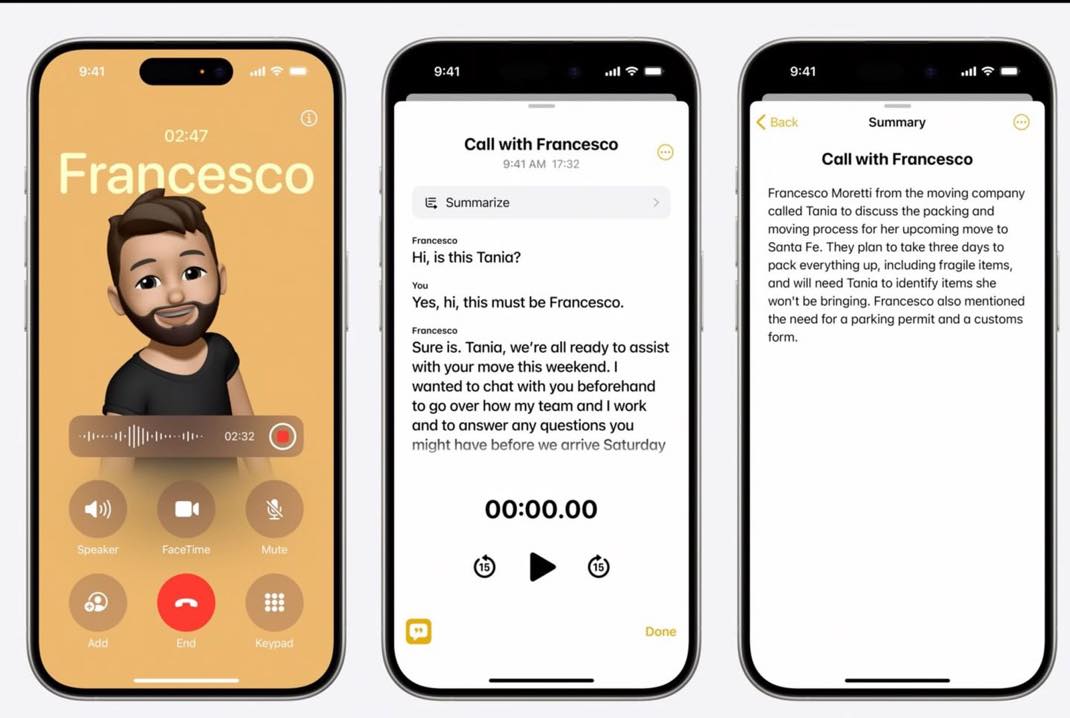

Apple a dévoilé de nouvelles API de transcription vocale dans iOS 26 et macOS Tahoe, des APIs qui affichent des vitesses de traitement nettement supérieures aux outils concurrents, notamment Whisper d’OpenAI. Lors de tests menés par John Voorhees (MacStories), un fichier vidéo de 34 minutes (7 Go) a été transcrit en seulement 45 secondes grâce à un outil en ligne de commande baptisé Yap (et développé par son fils). C’est 55 % plus rapide que le modèle MacWhisper Large V3 Turbo (basé sur l’API Whisper d’OpenAI), qui a mis 1 minute et 41 secondes pour transcription de la même vidéo. D’autres outils basés sur Whisper, comme VidCap ou MacWhisper V2, sont même encore plus lents !

Ces performances de premier plan doivent évidemment beaucoup au traitement en local de la transcription (directement sur l’appareil), ce qui permet d’éliminer les délais liés aux connexions réseau (contrairement aux services de transcription en cloud). Les nouvelles classes SpeechAnalyzer et SpeechTranscriber introduites par Apple permettent aussi d’améliorer la vitesse de traitement. Et bien que les gains de temps soient encore modestes sur un seul fichier, ils deviennent particulièrement significatifs pour ceux qui transcrivent régulièrement de longues vidéos, conférences ou podcasts.

Ça veut dire qu’Apple n’est pas à la ramasse, ils sont juste biiiien en retard

Comme d’habitude ils sont bien bien bien en retard,mais dès que ça sort,ils enfoncent la concurrence. Et c’est tout le temps comme ça

c est probablement l experience du iphone 12 mini qui va reprendre .

bel appareil tres design mais incapable de durer plus d une demie journée

Apple expérience utilisateur 100% Harmony os 80% Android 50%.Apple innovation 0 Samsung innovation 0.5 Huawei innovation 1

Rien compris.