iMessage : iOS 15.5 active les mesures de lutte contre la pédopornographie dans 5 pays

- Jean-Baptiste A.

- 17 Mai 2022à 15:57

- Actualité & avis iPhone / iPod

- 1 partages

- 11

- 4

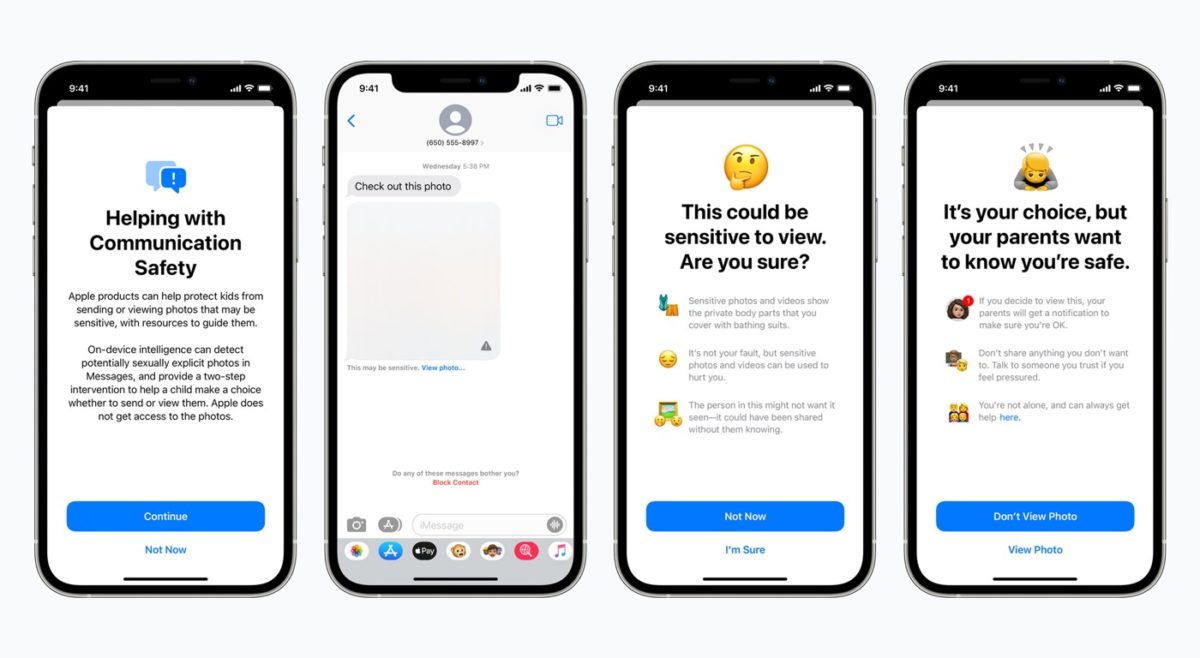

Apple propose cette semaine iOS 15.5 en version stable et cette mise à jour est notamment l’occasion d’avoir les mesures de lutte contre la pédopornographie au sein d’iMessage dans cinq nouveaux pays.

De nouveaux pays ont les mesures pour iMessage

Jusqu’à présent, ces mesures étaient disponibles aux États-Unis. Avec iOS 15.5, on les retrouve en Australie, au Canada, en Nouvelle-Zélande et au Royaume-Uni. Il n’y a pas encore d’information pour une disponibilité en France ou dans les autres pays.

Avec le système d’Apple, une analyse des iMessages envoyés et reçus est réalisée afin de déterminer s’il y a de la nudité. C’est un moyen de prévenir les enfants afin qu’ils n’ouvrent pas ce type de contenu. Si la nudité est détectée dans une photo reçue par un enfant, la photo est floutée et l’enfant recevra des ressources de groupes de protection de l’enfance. La nudité dans une photo envoyée par un enfant déclenchera un avertissement encourageant l’enfant à ne pas envoyer l’image.

Ce sont les parents qui ont le contrôle sur cette fonctionnalité et peuvent l’activer (ou non) sur l’iPhone de leurs enfants. Aussi, la vérification de contenus ayant de la nudité se fait directement sur l’iPhone et non sur les serveurs d’Apple.

Dictature je te souhaite la bienvenue 🤮

Tu as lu l’article ? Je ne pense pas. Déménage en Russie, Chine, Corée du Nord et consorts, et on reparlera dictature…

Pourquoi tu y as déjà été pour savoir comment ca se passe (en russie en particulier) ou tu répètes ce que les médias racontent?

+1

Moi qui aimais bien recevoir des photos de ma compagne il vas falloir éviter du coup 😵

C’est optionnel et activable par les parents sur le device des enfants + le traitement se fait en local … Je ne vois vraiment pas le pb et je pense que c’est une très bonne chose pour protéger les mineurs des images qui, a cet âge, ne sont pas consenties.

Bonne initiative pour la protection des enfants

Contrôle et flicage de la population sous couvert d’une bonne intention. Ce besoin de protection de l’état constamment m’exaspère. Un peu comme la dictature du « bon citoyen ». Tu veux contrôler les photos sur l’iPhone de ton petit? Donne lui un téléphone de base, devient parent qui sensibilise et supporte et cette loi sera inutile.

«Ce besoin de protection de l’état»? Ah oui! La fameuse République Populaire d’Apple, je vois.

Votre iPhone détecte déjà le contenu des photos que vous prenez en local. Ouvrez l’app Photos ; allez dans l’onglet « Chercher » ; tapez un terme vague comme « Ciel » ou « Chat ». L’iPhone va automatiquement filtrer vos photos. La seule différence est que c’est fait dans iMessage & que ça détecte la nudité.

Mesure totalement inefficace . C’est simplement un pompage de données supplémentaires par Apple qui continuera malgré tout dans ses pub de dire qu’il ne récupère pas tes donnée etc…