L’analyse de photos par Apple inquiète des journalistes

L’analyse des photos par Apple pour détecter du contenu pédopornographique inquiète beaucoup de monde, dont des journalistes. Des associations de journalistes germanophones en Allemagne, en Suisse et en Autriche font savoir qu’Apple pourrait très bien analyser d’autres contenus.

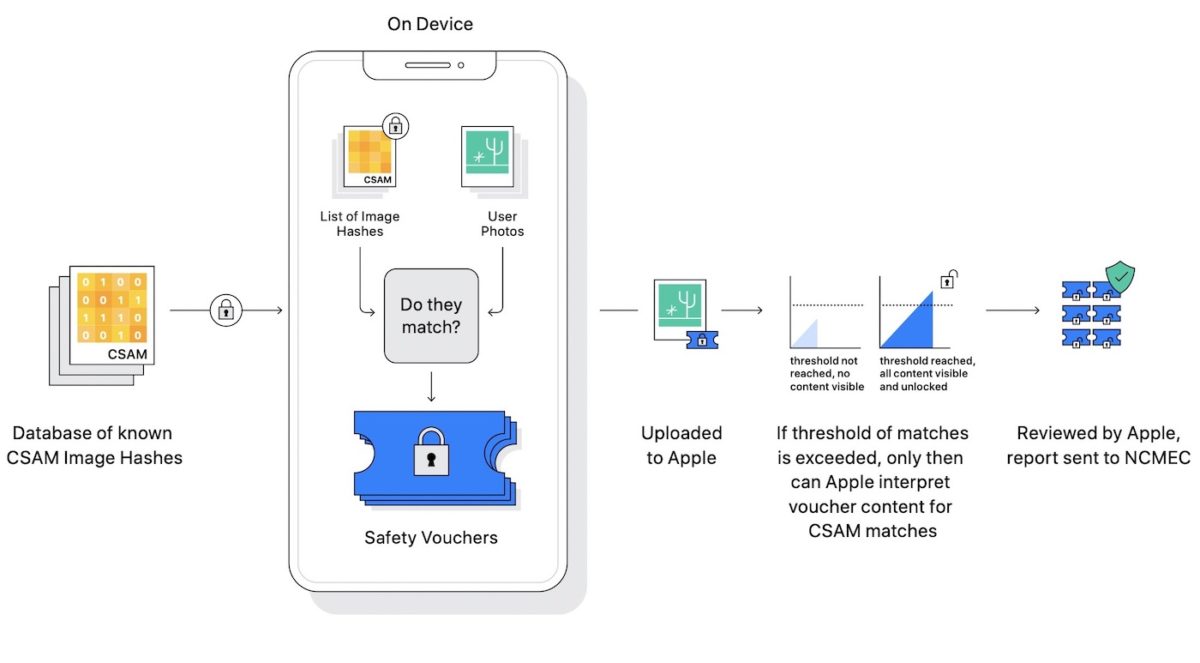

Apple assure que son système analysera uniquement les photos des utilisateurs à l’aide du hash. Mais les journalistes notent qu’Apple pourrait théoriquement analyser d’autres types de photos, voire d’autres types de contenus. Les journalistes craignent ainsi un non-respect de leurs sources selon les cas. On pourrait imaginer un gouvernement qui oblige Apple à analyser tel ou tel contenu si le contenu en question ne lui convient pas et fait l’objet d’articles dans la presse.

Les journalistes donnent quelques exemples, comme le fait de détecter des photos de dissidents et de minorités persécutées. Un autre cas évoqué concerne la Hongrie dont la politique va ouvertement à l’encontre de la communauté LGBT.

Le système d’Apple, qui sera en place à compter d’iOS 15, sera d’abord activé aux États-Unis. Mais Apple a déjà dit que les autres pays suivront dans quelques mois. Les journalistes germanophones soulignent au passage qu’ils ont des correspondants aux États-Unis et qu’ils vont connaître l’analyse dès qu’iOS 15 sera disponible au téléchargement.

À l’arrivée, les associations de journalistes veulent que la Commission européenne s’occupe de ce dossier, tout comme les ministères de l’Intérieur de chaque pays et les bureaux chargés respect du RGPD.

Je comprends l’inquiétude mais étant donné que le principe est de savoir si une personne possède une ou plusieurs photos contenues dans une base de données, il ne s’agit pas de scanner les photos avec une reconnaissance faciale pour chercher une personne bien précise… on est pas encore à ce stade de technologie… sauf dans les films ou séries 😉

Mieux vaut encadrer les avancées technologiques que de les refouler en bloc… on serait encore à frotter des cailloux pour se chauffer 😄

Oui il faut salut le progrès mais pas quand ce pour nous piste encore plus

Ben justement les gardes fous doivent être que c est un juge qui décide qui doit être soumis à ce scan de photos pour une enquête.Comme pour une mise sur écoute téléphonique

Il y a moins d un mois on aurait dit qu une entreprise privée scan toutes les photos de tous le monde c était un scandale.Il suffit de dire que c est pour de la pedopornographie c est normal.

Vous sous estimez la puissance de l IA méfiance

Avis aux amoureux de tartes aux pommes bien cuite ;)

Encore une fois personne n’a compris le fonctionnement de ce que propose Apple ! dommage

Si si on a bien compris.c est pas la méthode qui peut faire peur,c est la manière.Ils partent du principe que tout le monde est suspect et appliqué dans certains pays où il faut juste une loi pour forcer Apple à s adapter aux lois du pays ,ils changeront de manière

Personne se rend compte qu’une entreprise privée ne peut pas agir en utilisant leurs produits pour contrôler le citoyen..et le dénoncer aux autorités. KGB ce système.

Le principe de fonctionnement et parfaitement bien compris, mais pour en revenir au premier commentaire j’aurai une petite chose à ajouté (ne sous-estimé pas la technologies du 21 ième siècle) ont n’ait bien plus en avance sur la reconnaissance ciblé que vous le pensiez ;)