iMessage : les enfants pourront signaler des contenus de nudité à Apple avec iOS 18.2

- Jean-Baptiste A.

- 24 Oct 2024à 9:56

- Applications iPhone, iPad et Apple Watch

- 1 partages

- 0

- 4

Apple va proposer une nouvelle fonctionnalité sur iMessage qui permettra aux enfants de signaler au fabricant d’iPhone des photos et vidéos qu’ils reçoivent et qui contiennent de la nudité. C’est disponible avec la bêta d’iOS 18.2 et c’est pour l’instant limité à l’Australie.

Il s’agit d’une extension des mesures de sécurité des communications qui sont activées par défaut depuis iOS 17 pour les utilisateurs de moins de 13 ans ; les adultes peuvent aussi l’activer s’ils le souhaitent. Dans le cadre des fonctions de sécurité existantes, l’iPhone détecte automatiquement les images et les vidéos contenant de la nudité que les enfants pourraient recevoir ou tenter d’envoyer avec iMessage, AirDrop, FaceTime et l’application Photos. La détection s’effectue sur les appareils afin de protéger la vie privée.

Si une image sensible est détectée, le jeune utilisateur se voit présenter deux écrans d’intervention avant de pouvoir continuer, et se voit proposer des ressources ou un moyen de contacter un parent ou un tuteur.

Un signalement à Apple pour la nudité sur iMessage

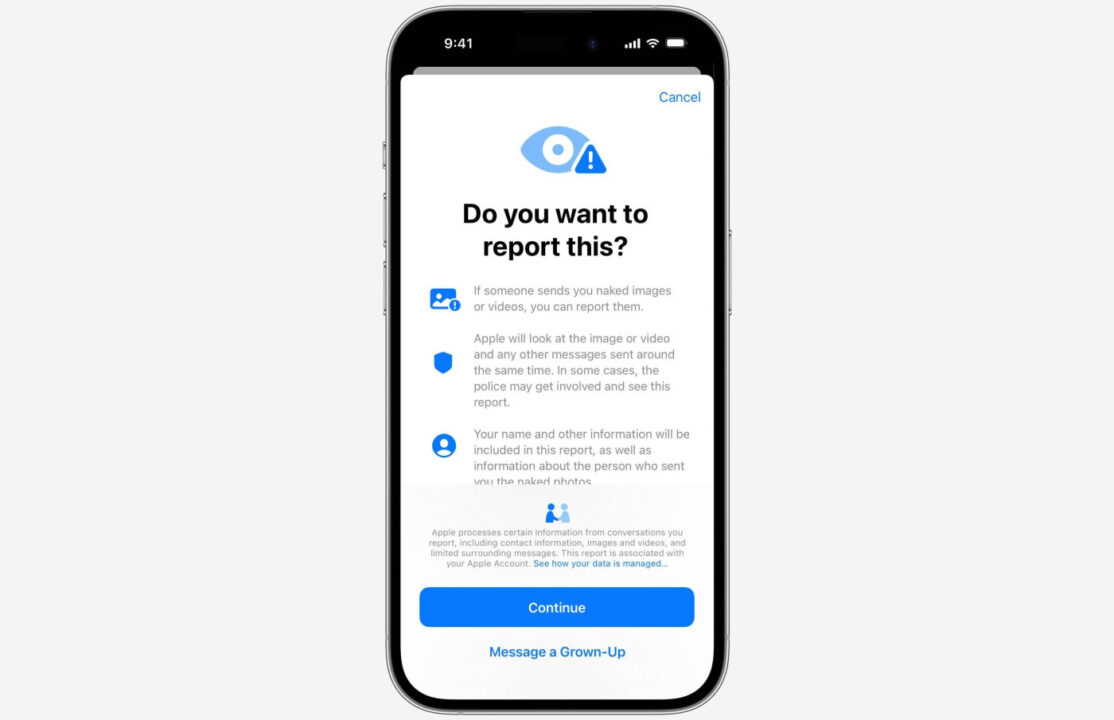

Avec iOS 18.2, une nouvelle option apparaît et permet de signaler à Apple un iMessage reçu qui contient une photo ou une vidéo avec de la nudité. L’iPhone établit un rapport contenant les images ou les vidéos, ainsi que les messages envoyés immédiatement avant et après l’image ou la vidéo. Cela inclut les coordonnées des deux comptes, et les utilisateurs peuvent remplir un formulaire décrivant ce qui s’est passé.

Apple va alors analyser le signalement et agir en conséquence. Cela peut notamment se traduire par désactiver le compte iMessage de l’expéditeur. Apple peut également contacter les forces de l’ordre qui pourront prendre d’autres mesures.

Apple a indiqué à The Guardian que la fonctionnalité sera d’abord disponible en Australie, mais elle arrivera plus tard dans le reste du monde. Pourquoi l’Australie au départ ? Cela coïncide avec l’entrée en vigueur de nouvelles règles. D’ici à la fin de l’année 2024, les entreprises tech seront tenues de surveiller les contenus relatifs à la maltraitance des enfants et au terrorisme sur les services de cloud computing et de messagerie opérant en Australie.