Pédopornographie : Apple va proposer son système aux applications tierces

Le système d’analyse de photos et de messages d’Apple pour lutter contre la pédopornographie pourrait bien débarquer sur les applications tierces. Le groupe a organisé aujourd’hui une session de questions/réponses avec certains médias à ce sujet.

Une ouverture aux applications tierces en projet

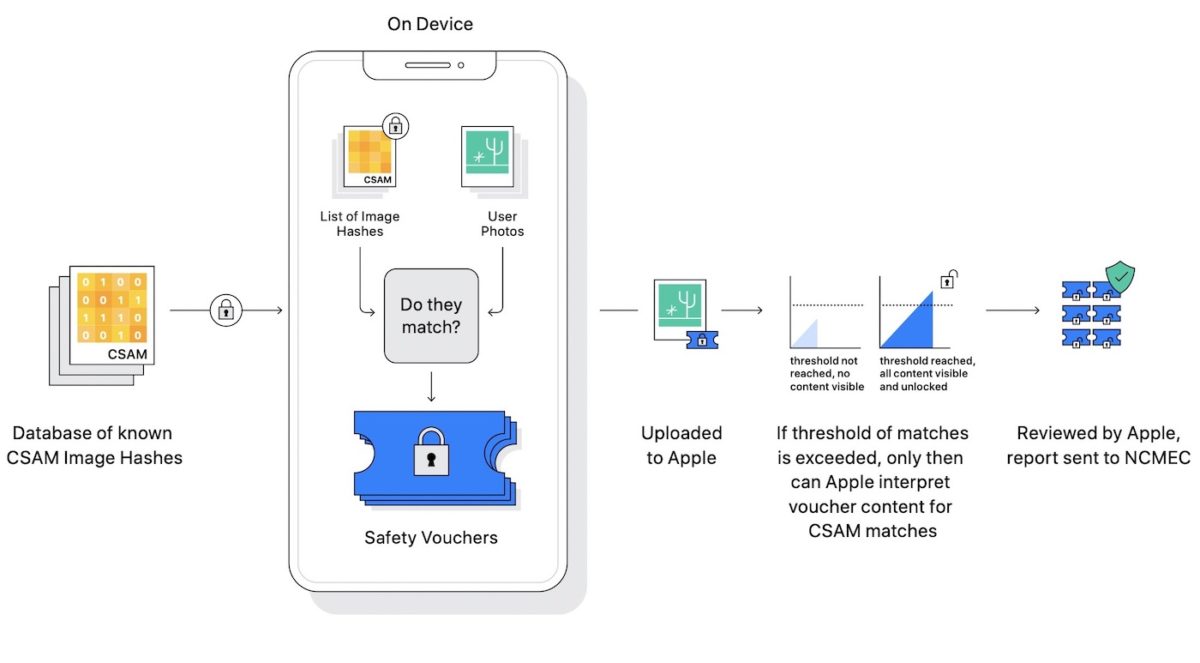

Apple indique des applications tierces pourraient être en mesure d’utiliser son mécanisme, ce qui leur permettrait de détecter les contenus à caractère pédopornographique et ainsi signaler l’utilisateur aux autorités compétentes. Il est toutefois difficile de dire exactement comment cela va fonctionner parce qu’Apple n’a pas partagé de détail.

Une possibilité serait que des applications WhatsApp, Snapchat, Instagram et autres puissent analyser les messages envoyés par les utilisateurs sur leurs plateformes et ainsi détecter quand il y a une personne nue dans un contenu. Les mineurs pourraient ainsi recevoir un avertissement leur indiquant qu’un contenu sexuel se cache derrière la photo envoyée par message. Le fait de l’ouvrir préviendrait les parents. C’est en tout cas comme cela que ça fonctionnera sur l’application Messages d’Apple et ça pourrait l’être tout autant sur les autres applications de messagerie. On soulignera toutefois que WhatsApp a déjà dit être contre ce système.

Une autre possibilité est le fait que la technologie d’Apple puisse analyser les photos qui sont envoyées par les applications sur des services autres qu’iCloud. Dans ce cas, les applications pourraient signaler tout utilisateur qui partage de la pédopornographie.

Il est bon de noter qu’Apple a parlé d’une nécessité de faire plusieurs tests. La disponibilité de son système de lutte contre la pédopornographie pour les applications tierces pourrait donc ne pas être disponible tout de suite. Concernant l’application Messages d’Apple et l’analyse de photos iCloud, ce sera en place avec iOS 15 et macOS Monterey.

Sous couvert d’une noble cause, la boîte de Pandore a été ouverte

Aujourd’hui le contenu pedo-pornographique, demain les positions politiques

Drôle de société vers laquelle nous allons….

Plus on avance, plus on apprend des trucs, plus j’ai envie de laisser tomber iOs et Android et passer chez Huawei et HarmonyOS…Pas besoin de se connecter avec un E-mail pour profiter de leur gallerie d’application et des mises à jour. Je crois que finalement, on est bien plus tranquille sans les USA qui font tout pour garder la Main mise sur le Monde…Je vais tester avec mes Xiaomi la vie sans Google, sans USa…

Huawei avec une backdoor pour le gouvernement chinois. Désolé mon ami même là on n’est pas à l’abris. Mais de toutes manières ça n’existe pas un logiciel et une entreprise totalement safe niveau éthique

MDR pourquoi tu parle de Le Pen ?

Le nouvel ordre technologique et en route les amis(e) ;)

Ca va être un beau bordel je le sent bien. Entre les erreurs d’interprétation et les ados adeptes des snap il vont tous regretter d’avoir voulu un iPhone 😂

Tim nous la bien fait savoir ! ceux qu’il ne sont pas comptant allez chez android ou autres (en résumé, cassez vous) ;)

Toujours aussi convaincu que le jailbreak ne sert à rien? :)

J’ai raté le moment où l’usage d’icloud était devenu obligatoire. Il me semblait que la malentendu « au zut notre sex tape est partie dans le cloud » remonte à un paquet d’années. Vous êtes grotesques avec vos comparaisons de benets. La détention d’image pédo-prono est un délit. Voter LEPEN non. Un hébergeur qui vérifie que les clients n’utilisent pas ses ressources pour commettre des délits assume juste sa responsabilité. Mais apparemment c’est pas un concept très à la mode d’être responsable.

C’est pas le problème. Et y’a aucun problème à voter le pen. Faudrait peut être tenter le coup une fois. Sinon, le fait de scanner les photos (même si ce ne sont que celles du cloud? Jsp) et de les comparer à une BDD sans l’aval de l’utilisateur est inacceptable. C’est le concept qui est critique ici, pas le but. Car ça servira à stopper la pedopornographie, mais ça ouvre des voies à encore plus de flicage et contrôle.

Le rapport avec Lepen??? 🤔

Le problème est que la méthode utilisée permet potentiellement d’aller bien au-delà de la cause évoquée. Ça permet techniquement un flicage de masse. Si ça ne vous dérange pas, n’insultez pas les gens qui pensent que c’est un problème.

Ce n’est pas à une organisation privée qui doit faire suivre les lois, et encore moins une firme d’électronique…faut arrêter.

Puis avant de fliquer les téléphones ils serait plus judicieux de bannir Twitter, snap, insta, whatsapp… où il y a de tout et n’importe quoi d’illégal dessus!…

Allons allons. Bannir ces sites la enlèverait l’utilité d’un smartphone pour beaucoup de gens. Soyons sérieux quand même.

Très inquiétant tout ça… Les sceptiques pourront avoir bientôt une preuve quand la Chine va utiliser cette technologie pour tout autre chose

Esprit confus est toujours vaguement inquiet.

Désolé mais je ne vois toujours aucun argument logique (« on veut pas être fliqués » n’est pas un argument) qui s’oppose au contrôle et à la dénonciation des infractions pouvant être commises sur les serveurs d’Apple. Je rappelle une fois encore que les images pédo-prono sont les seules représentations dont la simple détention est un délit (même un dessin). Quant à l’idée selon laquelle c’est le début de la fin « y a qu’à voir en Chine », pardon mais c’est de niveau CM1. Bien sur qu’à l’instar des écoutes téléphoniques, de la reconnaissance faciale ou des armes à feux, la scan des photo uploadées dans icloud peut servir une dictature, et plus généralement un système liberticide. Pourtant ce sont aussi des outils indispensables à la sécurité des personnes et à l’ordre public dans les démocraties les plus évoluées.

Indispensable mdrrr. Ce qu’il ne faut pas entendre.

C’est un mot que tu n’as pas compris ? Il est au pluriel dans mon post ce n’est pas indifférent. Le « s » ne s’entend pas mais si tu lis toi même tu le verra, c’est tout à la fin du mot.