Le fonctionnement d’Apple Intelligence décrit en détail dans une publication de recherche.

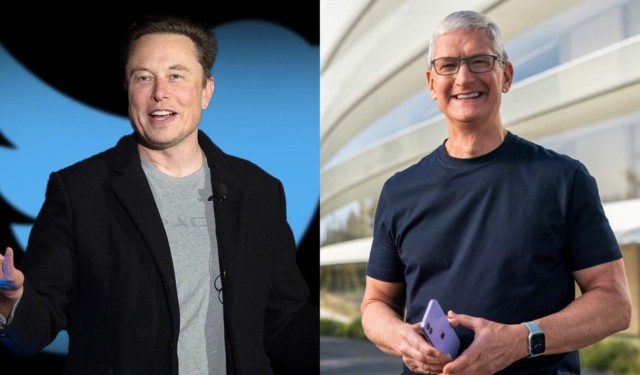

Face aux critiques venant de toutes parts (y compris une pique d’Elon Musk), Apple s’est décidé à publier une (très) longue page pour décrire le fonctionnement d’Apple Intelligence, son premier LLM à destination des utilisateurs. Une publication de recherche rédigée par Apple détaille Apple Intelligence comme aucune autre société d’IA ne l’a fait auparavant. Apple profite de cette longue explication de texte pour rappeler les points essentiels concernant l’usage des données utilisateur, y compris lors de la formation du LLM: « Nous n’utilisons pas les données personnelles privées de nos utilisateurs ou les interactions des utilisateurs lors de la formation de nos modèles de base. » Voilà qui ressemble fort à un attaque en règle contre le Grok d’xAI (Elon Musk), ce dernier étant entrainé avec le contenu des posts publiés par les utilisateurs sur X. Mieux encore, les données des utilisateurs iOS ou macOS ne servent pas à entrainer ChatGPT, alors que l’IA d’OpenAI est accessible directement via l’interface de l’iPhone ou du Mac.

Mais alors, comment a fait Apple pour entrainer son modèle ? C’est bien simple : la collecte de datas est effectuée sur le web, via un bot logiciel d’exploration et de récupération des données baptisé Applebot. Ce dernier « bossait » déjà pour Siri et a donc été réaffecté à la formation d’Apple Intelligence. Là encore, Apple se distingue puisque les données récupérées… sont sous licence, c’est à dire qu’Apple a fait en sorte d’obtenir l’autorisation de la collecte : « Nous formons nos modèles de base sur des données sous licence, y compris des données sélectionnées pour améliorer des fonctionnalités spécifiques, ainsi que sur des données disponibles publiquement collectées par notre robot d’exploration web, AppleBot. Les éditeurs web ont la possibilité de se désinscrire de l’utilisation de leur contenu web pour la formation Apple Intelligence avec un contrôle d’utilisation des données. »

Et pour empêcher toute récupération malencontreuse de données qui n’ont rien à faire là, Apple applique » des filtres pour supprimer les informations personnellement identifiables comme les numéros de sécurité sociale et de carte de crédit qui sont disponibles publiquement sur Internet. » Et bien entendu, Apple met en place d’autres filtres pour lutter contre « les stéréotypes et les biais systématiques » (principalement d’origines sociales) qui pourraient affecter les résultats de l’IA.

C’est n’importe quoi ce qu’ils racontent chez Apple. Ils ont juste utilisé un modèle de langage réduit de ChatGPT. Et acheter des données au lieu de les collecter eux-mêmes, c’est encore pire, parce qu’on ne sait pas vraiment ce qu’il y a dedans.

J’en ai lu des bêtises ici ! Mais la tienne est magique !😂😂

Il sait mieux ce qu’Apple a fait, qu’Apple eux-mêmes. Il est fort !

Tu dis n’importe quoi, et mélanges absolument tout là…

🫨😂😂😂😂😂😂😂😂🤣🤣🤣🤣🤣🤣🤣🤣🤣🤣🤣🤣