Apple est invité à arrêter les résumés de notifications par IA après des bourdes

L’organisation Reporters sans frontières demande à Apple de stopper sa fonctionnalité d’Apple Intelligence qui vient résumer les notifications sur iPhone après quelques bourdes en lien avec le journalisme. Cela a notamment touché BBC News et le New York Times.

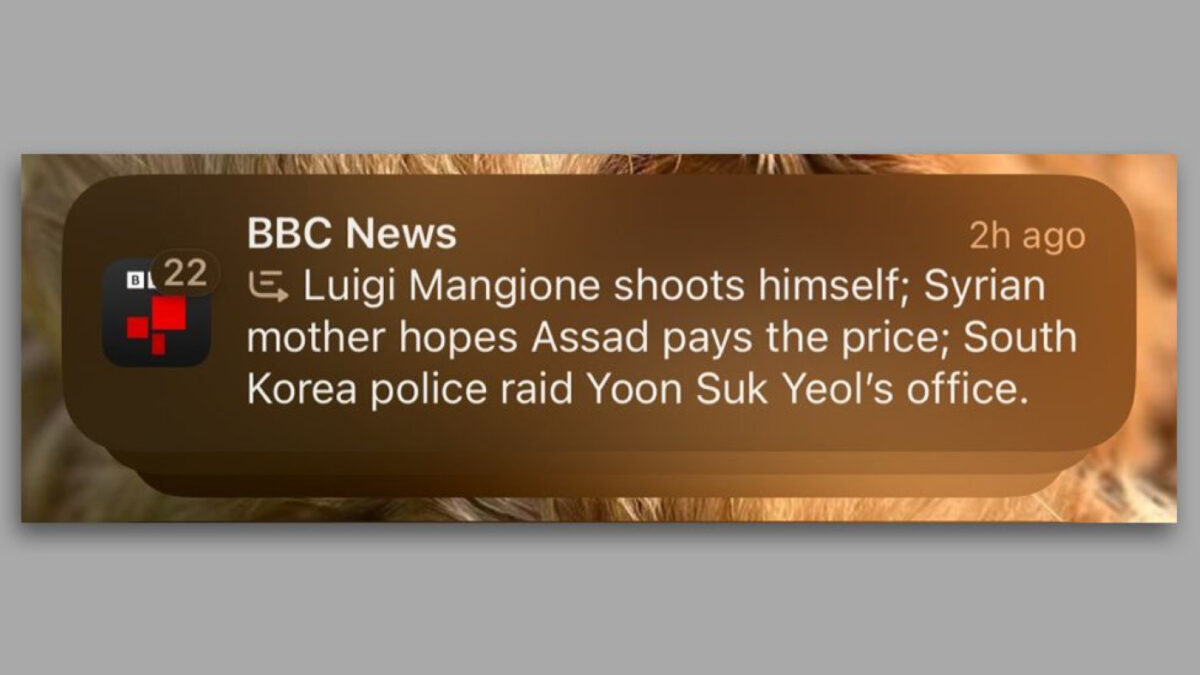

Il y a quelques jours, le résumé généré par Apple Intelligence a fait croire à tort aux utilisateurs d’iPhone que BBC News avait publié un article affirmant que Luigi Mangione, l’homme arrêté à la suite du meurtre de Brian Thompson, le PDG de la société d’assurance santé UnitedHealthcare, à New York s’était suicidé. Ce n’est pas le cas en l’occurrence. La notification qui contenait une fausse déclaration sur Luigi Mangione était toutefois exacte dans ses résumés concernant le renversement du régime de Bachar al-Assad en Syrie et une information sur le président sud-coréen Yoon Suk Yeol.

Reporters sans frontières veut qu’Apple arrête les résumés par IA

La BBC a déjà déclaré qu’elle s’était plainte auprès d’Apple. Aujourd’hui, l’organisation Reporters sans frontières se dit très préoccupée par les risques que représentent les nouveaux outils d’intelligence artificielle pour les médias. Elle estime que cet accident illustre le fait que les services d’IA générative sont encore trop immatures pour produire des informations fiables pour le public et ne devraient pas être autorisés sur le marché pour de telles utilisations.

Vincent Berthier, responsable du bureau technologie et journalisme de Reporters sans frontières, déclare :

Les IA sont des machines à probabilités, or la véracité d’une information ne se joue pas sur un coup de dés. RSF appelle Apple à prendre ses responsabilités en retirant cette fonctionnalité. La production automatisée de fausses informations portant le sigle de médias est une atteinte à leur crédibilité, et un danger pour le droit du public à disposer d’informations fiables sur l’actualité. L’AI Act européen, pourtant la législation la plus avancée au monde en la matière, n’a pas classé les IA générant de l’information comme systèmes à haut risque, laissant un vide juridique critique. Cette lacune doit être comblée rapidement.

Apple n’a pas réagi publiquement à cette affaire, que ce soit après la critique de BBC News ou de la demande de Reporters sans frontières.

On en parle des journalistes qui annoncent en direct les décès de certaines personnalités alors que c’est faux…

Avec justement des infos traînant sur le web des réseaux sociaux américains….

Plus Fake News y’a pas que là bas…

C’est vrai que les fakes news tu connais bien toi, avec toutes les absurdités et les chiffres que tu nous sors à longueur de temps hein.