Brevet : Apple planche sur une technologie audio principalement adaptée pour les environnements XR

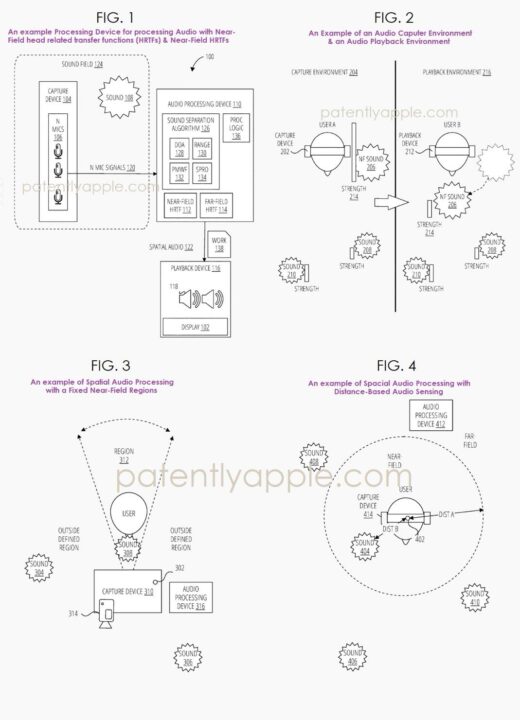

Apple a déposé (et obtenu) un nouveau brevet décrivant une technologie audio avancée capable de différencier les sons en champ proche (près de l’utilisateur) et en champ lointain (provenant de l’environnement), afin d’offrir une spatialisation sonore plus réaliste. Ce système audio utilise des filtres HRTF (Head-Related Transfer Functions) adaptés à la distance des sources pour éviter les distorsions, et s’avère capable aussi d’isoler les sons proches et de les traiter séparément ce qui permet un rendu audio plus précis et immersif. La technologie décrite dans ce brevet semble directement pensée pour les environnements de réalité étendue (XR) comme la réalité virtuelle, augmentée ou mixte, même si brevet liste pratiquement toutes les catégories de produits possibles.

Le brevet introduit également des options de personnalisation pour que l’utilisateur puisse ajuster la position des sons virtuels pendant la lecture. Le système tient compte de la forme du dispositif utilisé (casque, téléphone, lunettes connectées, etc.) et réagit à des éléments physiques comme les mouvements de tête ou les commandes vocales. Cette technologie pourrait enrichir de nombreuses expériences interactives : appels vidéo, concerts virtuels, enregistrement audio sur iPhone, ou encore navigation dans des mondes numériques immersifs avec un son 3D naturel et contextuel. A quand l’intégration dans une prochaine version de visionOS ?