Analyse de photos par Apple : l’Allemagne contacte Tim Cook après des inquiétudes

C’est au tour du Parlement allemand de s’inquiéter du système d’analyse de photos d’Apple pour lutter contre la pédopornographie. Manuel Hoferlin, le président du comité à l’agenda numérique, a contacté Tim Cook pour qu’Apple reconsidère son mécanisme.

Pour Manuel Hoferlin, Apple s’engage sur « une voie dangereuse » avec l’analyse de photos des utilisateurs pour lutter contre la pédopornographie. Le fabricant d’iPhone compromet « la communication sécurisée et confidentielle ». Tout ce système, qui sera en place à partir d’iOS 15, représente « la plus grande violation du barrage à la confidentialité des communications que nous ayons vue depuis l’invention d’Internet », indique le message.

Cette lettre du Parlement allemand arrive quelques jours à peine après une inquiétude de la part de plusieurs associations de journalistes germanophones en Allemagne, en Suisse et en Autriche. Elles s’inquiétaient que la détection d’Apple puisse aller au-delà de la pédopornographie, avec la société de Tim Cook qui pourrait analyser d’autres types de photos. Elle pourrait également analyser d’autres types de contenus.

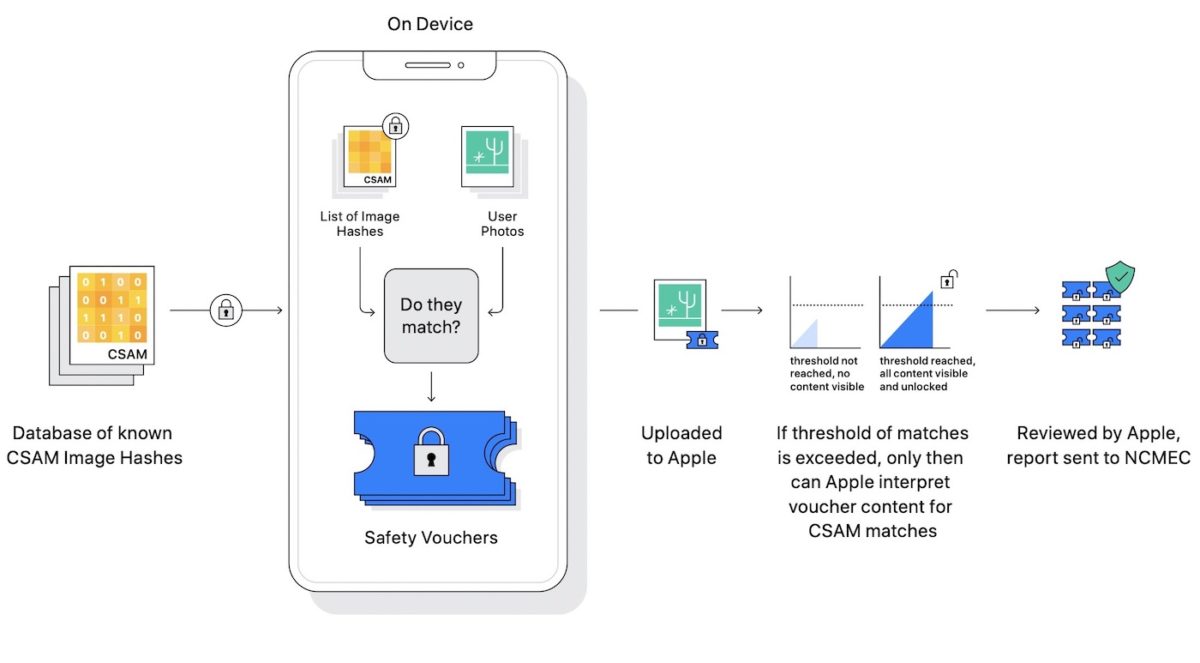

Dans le cas de la pédopornographie, iOS 15 va utiliser le système de hash pour vérifier si une photo a une correspondance avec une base de données. Celle-ci comprend des images pédopornographiques. Dès qu’il y a 30 images pédopornographiques détectées, Apple prévient les autorités et ferme le compte iCloud de l’utilisateur. Tout cela sera en place avec iOS 15, d’abord aux États-Unis. Mais les autres pays suivront au fil du temps.

En gros les gars qui auront 29 photos incriminées resteront tranquilles ?

J’avoue que j’ai du mal à comprendre pour le coup… T’imagine l’enquête… Ouff le gars n’a que 29 images sur son smartphone, j’ai cru que c’était un pédo :D :D :D

La France elle est où ….. des petit point pour reste polis

La Suisse s’y oppose…ouf ! Comment voulez vous que la France réagisse ? Le président est un pion et dévoué à la bourse….

Un dialogue de sourd entre cette entreprise et le reste du monde (l’ardre qui cache la foret) sa craint ;)

Un dialogue de sourd entre cette entreprise et le reste du monde (l’arbre qui cache la foret (oups)) sa craint ;)

J’ai un profond malaise avec cette nouvelle fonctionnalité.. Quoiqu’elle soit rempli de bonnes intentions, je trouve qu’Apple va trop loin. Beaucoup trop loin, surtout qu’ils se vente assez fréquemment du chiffrage de certaines de leurs autres fonctionnalités empêchant de relier telles informations à tels appareils ou utilisateurs.. Je trouve qu’Apple va trop loin et qu’il s’attire beaucoup plus de négatif que d’appréciations et que ceux qui ont justement ce genre de contenu trouveront bien un autre moyen qu’iCloud photos pour conserver leurs photos… D’ailleurs ce genre de personnes doivent déjà faire très attention pour ne pas être pincé, ils seraient bien idiots de téléverser ce contenu sur ce genre de plateforme Internet!

Et moi je trouve que ce son tes fautes de français qui vont trop loin… Autant de fautes pour ne rien dire (à part que c’est facile de se passer d’iCloud) ça me dépasse.