Pédopornographie : Apple reporte l’analyse de photos des utilisateurs

Apple a pris la décision de reporter le lancement de ses outils pour lutter contre la pédopornographie, ce qui inclut l’analyse de photos des utilisateurs. Le fabricant dit vouloir prendre un peu plus de temps au vu des critiques à tout-va.

Report du lancement pour les outils de lutte contre la pédopornographie

Voici ce qu’Apple déclare concernant le report de ses outils pour lutter contre la pédopornographie, qui devaient être en place dès le départ avec iOS 15 :

Le mois dernier, nous avons annoncé des plans pour des fonctionnalités destinées à aider à protéger les enfants contre les prédateurs qui utilisent les outils de communication pour les recruter et les exploiter, et à limiter la propagation des documents relatifs aux abus sexuels sur les enfants. Sur la base des commentaires des clients, des groupes de défense, des chercheurs et d’autres personnes, nous avons décidé de prendre du temps supplémentaire au cours des prochains mois pour recueillir des commentaires et apporter des améliorations avant de publier ces fonctionnalités de sécurité d’une importance cruciale pour les enfants.

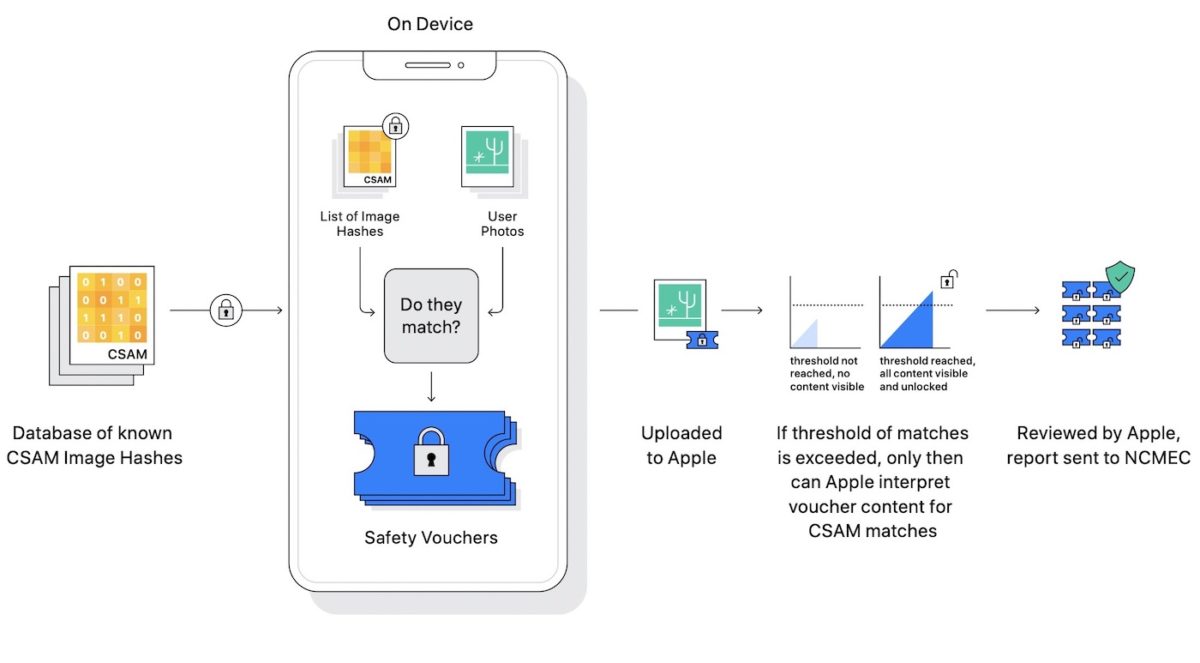

Ce système a effectivement généré toute une polémique. Apple avait annoncé analyser les photos des utilisateurs avec le hash pour faire une comparaison avec une base de données remplie de contenu pédopornographique. L’analyse se fait directement sur l’iPhone et non sur les serveurs d’iCloud. En cas de contenus correspondants, Apple s’était engagé à fermer le compte iCloud de l’utilisateur et prévenir les autorités compétentes pour arrêter cette personne.

Des critiques à tout-va

Apple a annoncé ses outils le mois dernier. Dans la foulée, de nombreux utilisateurs ont critiqué l’analyse de photos, tout particulièrement parce qu’elle a lieu sur l’iPhone. Des chercheurs en sécurité ont également critiqué le système, tout comme le lanceur d’alerte Edward Snowden et l’ONG Electronic Frontier Foundation (EFF) qui défend la protection des libertés sur Internet. Tous s’accordaient à dire qu’Apple pourrait très bien analyser d’autres types de contenus à l’avenir et qu’il s’agissait d’une backdoor (porte dérobée) sur les iPhone.

Cela va même plus loin, puisque les politiques ont décidé de directement contacter Apple sur le sujet. C’est notamment le cas en Allemagne. Toujours en Allemagne, des journalistes ont évoqué les problèmes du système.

Pas de nouvelle date de lancement

Au départ, Apple prévoyait de proposer ses outils de lutte contre la pédopornographie aux États-Unis avec iOS 15, iPadOS 15, watchOS 8 et macOS Monterey. Les autres pays devaient suivre plus tard. Apple ne dit pas maintenant quand le lancement aura finalement lieu, que ce soit aux États-Unis ou ailleurs.

C’est l’occasion de rappeler qu’Apple scanne déjà les contenus sur les e-mails d’iCloud, et ce depuis 2019, pour détecter des contenus pédopornographiques.

Tres bonne nouvelles..

Je comprends pas bien pourquoi, si personne n’a rien à se reprocher

Si tu n’as aucun problème à être présumé coupable et à ce que ta vie soit fouillée, c’est plutôt toi que j’ai de la peine à comprendre. C’est un peu comme accepter qu’une entreprise privée vienne fouiller chez toi pour voir si tu n’as rien à te reprocher

Pk ne pas mettre des cameras et etre surveiller h24 si t’as rien a te reprocher ? Montre nous donc l’exemple ;)

Dans ce cas, ça ne te dérange pas que je rentre chez toi pour vérifier que tu n’as rien volé ou autre ? Que je consulte ton historique internet pour savoir quel site tu regardes et également demander à ton conjoint ce que vous faites au lit ? Si tu n’as rien à te reprocher ça va non ? :)

C’est mieux comme ça pour que tu comprennes ?

Il faut relire les articles sur la fonctionnalité en question les enfants, vous vous égarez les enfants là

Je savais même pas qu’il scannait déjà les mails

Ils ont surtout peur des pertes avec les gouvernements qui voient pas du bonne oeil le check des photos. Simple histoire de pognon comme d’habitude

« Ils ont surtout peur des pertes avec les gouvernements » +1

Niveau financier et pénal

Le risque pénal c’est celui qu’Apple encours pour ne pas contrôler les données stockées sur ses serveurs en fait. D’où le système imaginé et annoncé la semaine dernière. Ce que dit Ljuba à juste titre c’est qu’il suffit que deux trois groupes et/ou politiques démagogiques l’ouvrent pour que la firme obtempère immédiatement, question d’argent. C’est un comportement qui a un nom très simple que l’on ne doit pas écrire ici je crois

Tant mieux. J’espère que ça ne verra jamais le jour. Qu’ils le fassent pour les e-mails c’est normal, mais la ils allaient trop loin. Trop de contact avec les gouvernements autoritaires, ça leur a done des idées.

Bon débarras.

Vu qu’aux USA, le Texas demande aux citoyens de dénoncer une femme qui veux ou a avorter au bout de 6 semaines…viol ou pas…c’est ça l’Amérique….

Les gentils americains les mechants russes etc t’as bien appris tes lecons bfm

Genre normal qu’une société privée check les pueces jointe de tes mail personnel ? Ou va le monde ? Ils ont donc carte blanche pour tout nous faire vu que vous etes d’accord pour etre fliqué de partout…

Sachant que les données sont stockés sur leur serveur (mail, pièce jointe, etc..) il est normal qu’ils vérifient. Ne serait-ce que d’un point de vue légal (stockage d’image pedo sur leurs serveur ? Moyen..)

Si tu ne veux pas te faire flicker, rien ne t’empêche de build ton propre serveur mail, avec ton propre nom de domaine pour ne rien stocker chez personne.

Je comprends le problème avec l’analyse des photos sur l’iPhone directement. Justement, c’est un bon moyen de ne pas avoir de fuite de photos perso, puisque c’est l’iPhone qui recherche en local, et rien n’est envoyé sur les serveurs d’Apple

Apple ne sont pas ma police…entreprise lucrative

Apple ferait mieux de regarder ce qui ce passe sur les applications de rencontre disponible sur le store. De nombreux mineurs sont présents dessus. Il faudrait justifier son identité pour télécharger les applications réservées au public adulte

Alors la je dit bravo ! le donneur de leçon ces fait tiré les oreilles, ouf un système d’espionnage en moins temporairement j’entends bien mais c’est déjà ça :)))

Vous vous plaigniez qu’Apple s’introduiraient dans notre vie privée en analysant nos photos lol… je vais pas vous refaire le discours, mais vous êtes déjà pistés avec vos smartphone.

Personnellement je trouve ça très dommage qu’Apple reporte l’analyse des photos, je fais partie de ceux qui voudraient que la peine maximale soit appliqué aux pédophiles, très dommage de ne pas pouvoir les tracker !