iOS 27 aura un mode Siri pour l’IA visuelle dans l’app Appareil photo

Apple prépare un « mode Siri » pour son application Appareil photo sur iPhone avec iOS 27 afin d’y mettre un peu plus d’intelligence artificielle, selon Bloomberg. Il y aura également l’intelligence visuelle intégrée.

Siri et l’IA visuelle sur iPhone avec iOS 27

Avec iOS 27, Siri apparaîtra directement comme un mode à part entière dans l’application Appareil photo, aux côtés de Photo, Vidéo, Portrait et des autres options déjà présentes.

Ce repositionnement change la nature de la fonction. Au lieu de passer par une interface séparée, l’utilisateur pourra activer directement ce mode depuis l’endroit où il prend des photos.

Apple conserverait aussi le raccourci via le bouton « Commande de l’appareil photo » qui a fait ses débuts sur le côté droit de l’iPhone 16 en 2024. Mais cette pression prolongée ne renverrait plus vers une interface à part, puisqu’elle lancerait désormais le mode Siri intégré à l’appareil photo.

La refonte passerait aussi par l’interface. Apple remplacerait l’actuel bouton blanc de capture de l’intelligence visuelle par un nouveau déclencheur inspiré du logo d’Apple Intelligence, signe que la fonction ne serait plus traitée comme un module isolé.

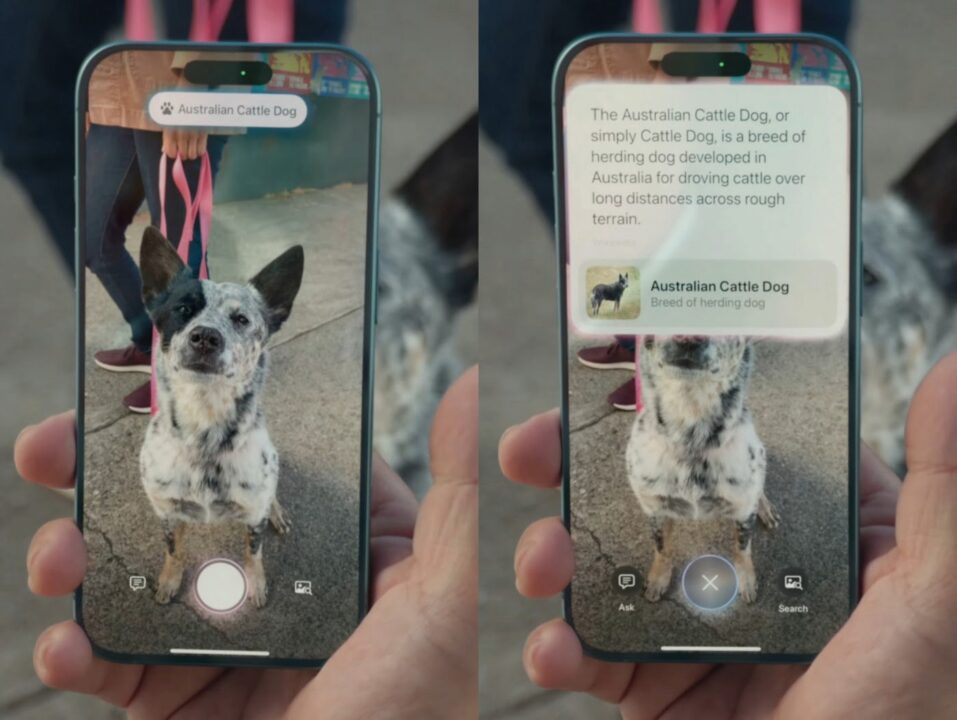

Les usages resteraient proches du principe actuel avec une exposition beaucoup plus naturelle. L’utilisateur pourrait pointer la caméra vers un objet ou une scène, puis interroger des services comme ChatGPT ou lancer une recherche inversée Google pour obtenir davantage d’informations.

La fonction intelligence visuelle existante

Apple prépare des usages plus pratiques

Le système actuel sait déjà transformer une affiche de concert en événement de calendrier, reconnaître des plantes et des animaux ou afficher des informations sur un commerce comme un numéro de téléphone ou des détails de menu. Avec iOS 27, Apple chercherait surtout à pousser cette logique vers des actions plus concrètes et plus immédiatement utiles.

Deux ajouts illustrent bien cette direction. Le premier consisterait à scanner une étiquette nutritionnelle pour enregistrer des informations alimentaires, tandis que le second permettrait de capturer et d’ajouter directement des coordonnées de contact à partir de ce que voit la caméra.

Ce déplacement vers l’utilitaire compte probablement autant que les nouveaux usages de Siri. Apple ne placerait plus son IA visuelle dans une zone expérimentale ou secondaire, mais dans un geste quotidien qui consiste simplement à ouvrir l’application Appareil photo et viser quelque chose.

Cette évolution a aussi un intérêt plus large pour la suite de la gamme. Apple travaille sur de nouveaux appareils centrés sur une version de Siri IA capable d’analyser l’environnement, avec au programme de nouveaux AirPods avec caméras, des lunettes connectées et un pendentif.

Dans cette perspective, l’iPhone sert visiblement de terrain de préparation. Si Apple habitue d’abord les utilisateurs à interroger le réel à travers la caméra, il devient plus simple ensuite d’étendre ce réflexe à d’autres objets portés en permanence.

En parallèle, iOS 27 doit aussi apporter de gros changements à Siri lui-même, avec des fonctions IA longtemps promises, une interface plus proche d’un chatbot et une application autonome. Apple prévoit également d’améliorer les performances, l’autonomie et la stabilité de ses systèmes, tout en préparant une nouvelle application Photos enrichie d’outils de retouche IA.